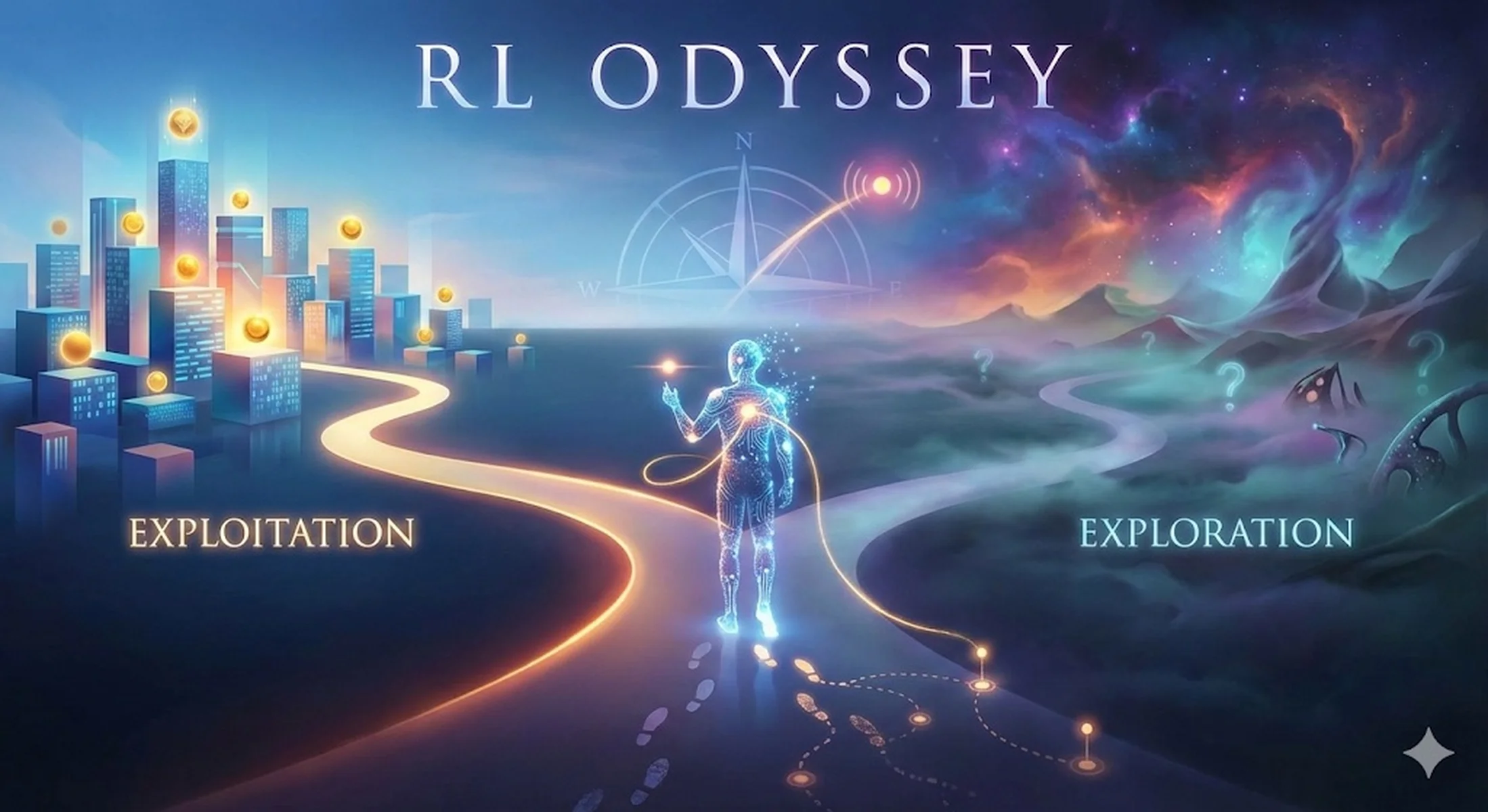

RL 奥德赛:智能的演化之旅

"Life can only be understood backwards; but it must be lived forwards." — Søren Kierkegaard (生活只能向后理解,但必须向前经历。——这也是时序差分学习与蒙特卡洛方法的某种写照)

专栏简介

强化学习(Reinforcement Learning, RL)是人工智能版图中极具生命力的一块拼图。它不同于监督学习对“标准答案”的依赖,也不同于非监督学习对静态分布的观察。RL 模拟的是生命的学习方式——在与环境的交互中,通过试错(Trial and Error)来优化策略。

本专栏“RL 奥德赛”旨在记录这一探索过程。我们将从基础的表格型方法出发,一路航行至深度强化学习(DRL)的浩瀚海洋。

哲学视角

在这里,我们不仅关注 Bellman 方程的数学美感,更希望通过哲学的透镜审视 RL 的核心命题:

-

存在即交互 (Existence as Interaction) 智能体(Agent)并非独立于世界的旁观者,而是通过动作(Action)改变状态、进而重塑环境的参与者。我是我环境的产物,也是我环境的创造者。

-

奖励假说 (The Reward Hypothesis) DeepMind 的 Silver 等人提出“Reward is enough”。但所有的目标、欲望与意义,真的都能被形式化为标量信号的累积最大化吗?

-

探索与利用 (Exploration vs. Exploitation) 我们应满足于已知的安稳(利用),还是冒险去寻找未知的可能性(探索)?这不仅是 -greedy 策略的参数,也是每个人生阶段面临的永恒博弈。

-

延迟满足与信度分配 (Credit Assignment) 当下的行动可能在很久之后才产生回响。在漫长的时间跨度中,如何准确地将未来的果归因于当下的因?这是 RL 的核心难题,也是长期主义者的必修课。

开始你的旅程,向着不确定性的迷雾深处。